Frankfurt (ots) –

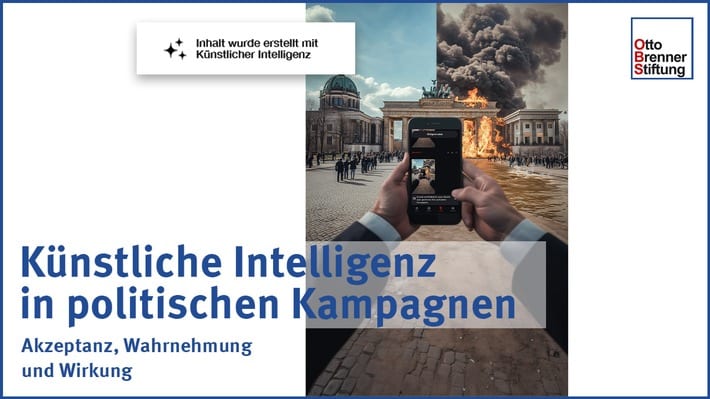

+++ OBS-Studie untersucht, wie die deutsche Bevölkerung KI-generierte Inhalte in politischen Kampagnen bewertet und wahrnimmt +++ Repräsentative Befragung zeigt verbreitete Skepsis und Sorgen um einen Verlust der Glaubwürdigkeit politischer Botschaften +++ Maßnahmen für transparenten Umgang mit KI, Kennzeichnungspflichten sowie die Überprüfung KI-generierter Inhalte durch unabhängige Expert*innen erhalten hohe Zustimmung +++ Online-Experiment zur Wahrnehmung und Wirkung KI-generierter Inhalte verdeutlicht: Künstliche Kampagnenbilder kaum von echten Bildern zu unterscheiden +++ Ethische Standards und mehr Medienkompetenz zum Thema KI nötig +++

Die deutsche Bevölkerung begegnet dem Einsatz von generativer Künstlicher Intelligenz (KI) im Wahlkampf mit großer Skepsis und Sorge: Über 50 Prozent bewerten KI-Inhalte in politischen Kampagnen als gefährlich, eine große Mehrheit fordert Kennzeichnungspflichten (83%) sowie eine Überprüfung künstlich erzeugter Inhalte durch unabhängige Expert*innen (75%). Zugleich unterscheiden sich KI-generierte Bilder in ihrer Wirkung kaum von echten Fotografien: In beiden Fällen sind die Inhalte der Botschaft ausschlaggebend für die Wahrnehmung der Rezipient*innen. Die rasante Entwicklung der KI-Modelle erweitert entsprechend die Möglichkeiten bestehender politischer Kampagnenarbeit, verändert aber nicht die grundlegende Wirkungsweise politischer Kommunikation. Das sind zentrale Ergebnisse der Studie „Künstliche Intelligenz in politischen Kampagnen“, die die Otto Brenner Stiftung heute veröffentlicht hat.

Für die Untersuchung haben die Kommunikationswissenschaftler*innen Simon Kruschinski, Pablo Jost, Hannah Fecher und Tobias Scherer von der Johannes Gutenberg-Universität Mainz rund 2.000 Menschen zu ihrem Wissen über KI befragt und um Einschätzungen zur Nutzung von KI in der Politik gebeten. Zudem wurde in einem Online-Experiment die Wahrnehmung und Wirkung KI-generierter Kampagnenbilder untersucht.

„Die deutsche Bevölkerung sieht mehr Risiken als Chancen durch den Einsatz künstlich generierter politischer Inhalte und wünscht sich verbindliche Regeln zur Überprüfung und Transparenz“, fasst Autor Simon Kruschinski zentrale Ergebnisse der Befragung zusammen. Die Akzeptanz von KI variiert dabei stark nach Anwendungsbereich. Während der Einsatz zur Bearbeitung von Texten Zustimmung erfährt, lehnen über 40 Prozent die Erstellung von realistischen Fotos und Videos mittels KI ab.

Die Studie belegt Schwierigkeiten unter Rezipient*innen zwischen KI-generierten und echten Kampagnenbildern zu unterscheiden. Während eine KI-Kennzeichnung bei der Erkennung hilft, zeigen Aufklärungstexte nur eine begrenzte Wirkung. Darüber hinaus hat der Inhalt KI-generierter Bilder Einfluss auf die generelle Bewertung des Einsatzes von KI in der Politik. Künstlich generierte Bilder mit positiver Botschaft werden als authentischer wahrgenommen, verringern die Skepsis gegenüber dem KI-Einsatz allgemein und steigern die Akzeptanz von Parteien, die KI nutzen. Einen Einfluss haben auch persönliche Faktoren wie Alter und Geschlecht sowie die eigenen politischen Einstellungen. „Ob KI-Inhalte erkannt und wie kritisch sie bewertet werden, hängt auch davon ab, ob die Botschaften mit der eigenen Weltsicht übereinstimmen“, resümiert Autor Pablo Jost.

Eine weitere zentrale Erkenntnis der Studie ist: In ihrer emotionalen Wirkung unterscheiden sich KI-Bilder kaum von realen Fotografien, beide Bildformen wirken über die dargestellte Stimmung sowie das Bildthema. „Mit dem Einsatz von KI entstehen keine grundlegend neuen Wirkungsdynamiken in der politischen Willensbildung. Was sich verändert, ist die Effizienz, mit der Kampagnen umgesetzt werden können“, so Jost. Es sei nicht entscheidend, ob KI verwendet wird, sondern für welche Ziele dies geschehe. KI-Modelle ermöglichen politischen Kampagnen gezielt spezifische Emotionen und Weltbilder anzusprechen, fördern eine schnelle Verbreitung der Inhalte sowie eine unkritische Rezeption und können entsprechend auch zum Zweck der Desinformation eingesetzt werden. Der Einsatz von KI durch politische Parteien sollte daher von unabhängigen Stellen kontrolliert werden, fordern die Autor*innen.

„Die Entscheidung der zentralen Social-Media-Plattformen, Inhalte zukünftig nicht mehr auf ihren Wahrheitsgehalt zu kontrollieren, ist vor diesem Hintergrund besonders kritisch zu bewerten“ sagt OBS-Geschäftsführer Can Gülcü. Derzeit wird die durch KI ausgelöste Emotionalisierung und Skepsis gegenüber der Glaubwürdigkeit von (politischen) Inhalten insbesondere von der politischen Rechten ausgenutzt. „Je mehr Desinformation und Deepfakes durch KI generiert werden, desto leichter können politische Akteure Zweifel an eigentlich wahren Aussagen oder Bildmaterialien säen“, fasst Simon Kruschinski diese Strategie zusammen. Zudem nutze die politische Rechte das „Aufregerthema KI“ strategisch für mediale Aufmerksamkeit. Entsprechend wichtig sei es, dass Medien evidenzbasiert über den Einsatz und die Wirkung KI-generierter Inhalte in der Politik berichten und nicht jede Provokation der AfD zum Thema machen.

Kruschinski/Jost/Fecher/Scherer: Künstliche Intelligenz in politischen Kampagnen. Akzeptanz, Wahrnehmung und Wirkung. OBS-Arbeitspapier 75, Februar 2025.

Kostenfreier Download der Studie: www.otto-brenner-stiftung.de/generative-ki-in-politischen-kampagnen

Pressekontakt:

Otto Brenner Stiftung

Geschäftsführer

Can Gülcü

Telefon: 069-6693-2526

E-Mail: info(at)otto-brenner-stiftung.de

www.otto-brenner-stiftung.de

Original-Content von: Otto Brenner Stiftung, übermittelt durch news aktuell

Quelle: ots